Çağdaş Çetindemir teyithatti

Türkiye Bilimsel ve Teknolojik Araştırma Kurumu (TÜBİTAK) üretken yapay zekanın sorumlu ve etik kullanımını sağlamak amacıyla "Destek Süreçlerinde Üretken Yapay Zekanın Sorumlu ve Güvenilir Kullanımı Rehberi" hazırladı. Dezenformasyon ve yanlış bilgi odaklı tehditleri de içeren raporda Birleşmiş Milletler Eğitim, Bilim ve Kültür Örgütü (UNESCO) ve Ekonomik İşbirliği ve Kalkınma Teşkilatı (OECD) gibi uluslararası kuruluşların, üretken yapay zekanın kötüye kullanımına dair raporlarında yer alan yanıltıcı-hatalı çıktılar, dezenformasyon üretimi, veri gizliliği ve güvenlik sorunları gibi konulardaki ciddi endişeleri aktarıldı.

TÜBİTAK resmi internet sitede erişime açılan Ocak 2026 tarihli raporda yanlış bilgi üretimi, ana risklerden biri olarak ele alınıyor. Raporla, temelde TÜBİTAK destek programlarına başvuran ve değerlendirme/izleme gibi süreçlerde yer alan kişi ve ekipler için üretken yapay zeka araçlarının etik, sorumlu ve yasalara uygun kullanımına yönelik kapsamlı bir rehber sunmak amaçlandı. Rehberde yapay zeka-yanlış bilgi bağlamında öne çıkan bilgiler sıralandı:

Üretken yapay zeka nedir?

Büyük veri kümeleri üzerinde eğitilmiş karmaşık modelleri kullanarak, verilen komutlar (prompt) doğrultusunda metin, bilgisayar kodu, görsel materyal, sentetik veri gibi yeni içerikler üretebilen -GPT, Google Gemini, Claude, Imagen, Veo gibi- yapay zeka sistemleridir. Bunların temel ayırt edici özelliği, eğitim verilerinde doğrudan bulunmayan, yeni içerikler oluşturma kapasitesidir.

Yanlış bilgi üretimi (Halüsinasyon/Konfabulasyon) nedir?

Üretken yapay zeka sistemlerinin, eğitim verilerinde yeterli bilgi bulunmadığında veya modelin iç sınırlamaları nedeniyle ürettiği, kulağa makul gelen ancak gerçekte yanlış, anlamsız veya uydurma olan çıktılardır.

Algoritmik önyargı nedir?

Bir yapay zeka sisteminin, eğitim verilerindeki mevcut toplumsal önyargıları yansıtması veya algoritmanın tasarımındaki kusurlar nedeniyle sistematik olarak belirli gruplar lehine veya aleyhine hatalı ve adaletsiz sonuçlar üretmesi.

Rehber, TÜBİTAK destek programlarına başvuran araştırmacılar, öğrenciler ve kurumlar için "Kurallar ve Tavsiyeler" içeriyor. Raporda üretken yapay zeka kullanımına ilişkin kurallar, izin verilen durumlar, sorumluluklar, riskler, kısıtlar ve yasaklar paylaşıldı. Temel ilke olarak başvuru sahibinin, üretken yapay zekayı bir araç olarak kullanırken bile sunulan içeriğin doğruluğundan, özgünlüğünden ve etik uygunluğundan tamamen sorumlu olması gerektiği vurgulandı. Raporda üretken yapay zeka kullanımının sağladığı kolaylıkların yanında önemli riskler barındırdığına da dikkat çekildi.

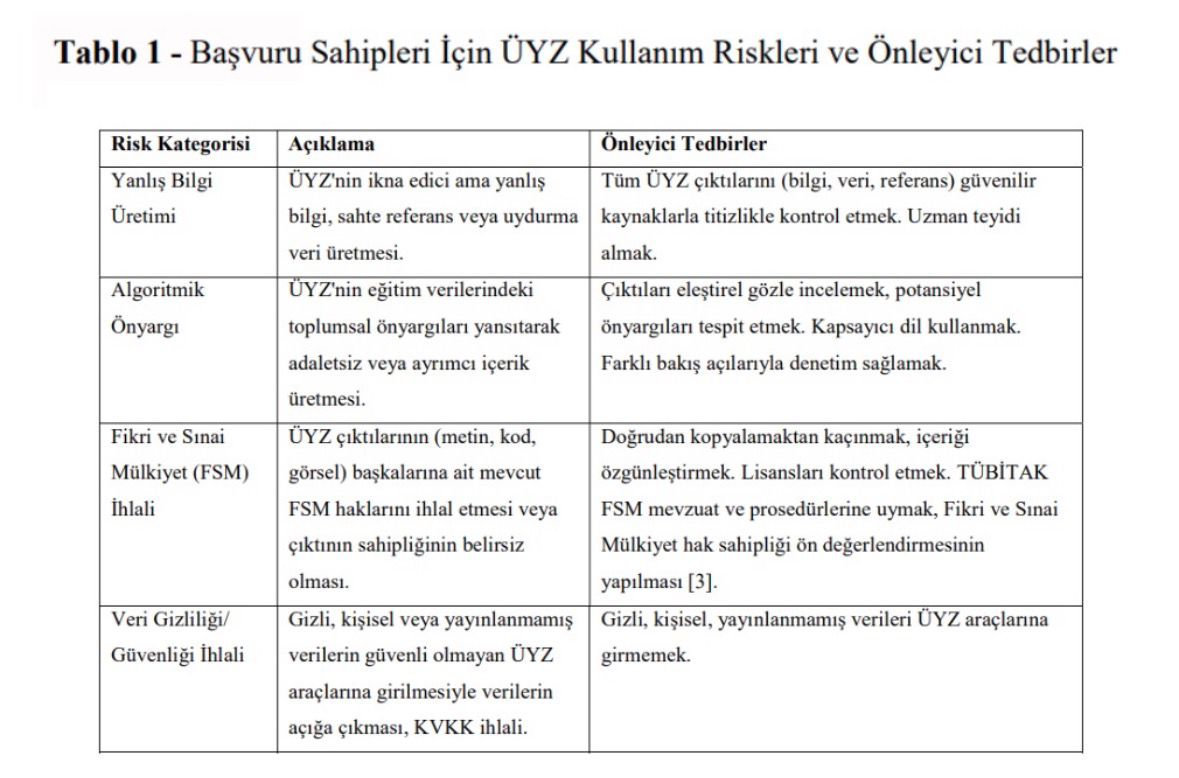

Yanlış bilgi üretimi: Üretken yapay zeka, özellikle eğitim verilerinde olmayan veya çelişkili bilgilerle karşılaştığında, son derece ikna edici görünen ancak tamamen yanlış veya anlamsız bilgiler, sahte referanslar veya gerçekte var olmayan veriler üretebilir. Önlem olarak yapay zekadan alınan her türlü bilgi (özellikle olgusal iddialar, sayılar, tarihler, referanslar) güvenilir ve bağımsız kaynaklarla titizlikle kontrol edilmeli, üretken yapay zeka tarafından üretilen herhangi bir veri veya analiz, alan uzmanlığıyla ve mümkünse alternatif yöntemlerle doğrulanmalı, üretken yapay zeka çıktılarına asla sorgulamaksızın güvenilmemeli.

Algoritmik önyargı: Modeller eğitildikleri devasa veri kümelerindeki mevcut toplumsal önyargıları (cinsiyet, ırk, etnik köken, yaş vb. temelli) öğrenebilir ve ürettikleri içeriklerde bu önyargıları farkında olmadan yansıtabilir hatta güçlendirebilir. Bu durum, proje önerisinin dilinde, önerilen yöntemde veya beklenen etkilerde adaletsiz veya ayrımcı unsurların ortaya çıkmasına neden olabilir. Önlem olarak modellerce üretilen metinler ve öneriler eleştirel bir bakış açısıyla incelenmeli, potansiyel önyargılar tespit edilmeye çalışılmalı, proje dilinin kapsayıcı ve tarafsız olması sağlanmalı.

Raporda bu iki maddeye ek olarak "Fikri ve Sınai Mülkiyet İhlali" ve "Veri Gizliliği ve Güvenliği, KVKK İhlali" konusundaki risklere de yer verildi.

Üretken yapay zekanın sunduğu parlak fırsatların yanı sıra dikkate alınması gereken önemli riskler ve etik zorlukları da barındırdığı belirtilen raporda, "OECD ve UNESCO gibi uluslararası kuruluşlar, üretken yapay zekanın kötüye kullanımı, hatalı veya yanıltıcı çıktılar (halüsinasyonlar/konfabülasyonlar), önyargıların pekiştirilmesi, fikri ve sınai mülkiyet hakları ihlalleri, veri gizliliği ve güvenliği sorunları, dezenformasyon üretimi gibi konularda ciddi endişeleri dile getirmektedir" ifadeleri kullanıldı. Raporda üretken yapay zekayla ilgili kullanım riskleri ve önleyici tedbirler ise bir tablo olarak paylaşıldı.

Yanlış bilgi üretimi konusunda "Tüm üretken yapay zeka çıktılarını (bilgi, veri, referans) güvenilir kaynaklarla titizlikle kontrol etmek ve uzman teyidi almak" gerektiğinin altı çizildi. Algoritmik önyargıda ise "Çıktıları eleştirel gözle incelemek, potansiyel önyargıları tespit etmek, kapsayıcı dil kullanmak, farklı bakış açılarıyla denetim sağlamanın" önemi vurgulandı.