Bir Kuveytlinin ABD askerine sopayla diz çöktürdüğünü gösterdiği iddia edilen görsel, yapay zeka filigranı taşıdığı için “yapay zeka üretimi” olarak değerlendirildi. Ancak olay yerinden paylaşılan videolar, konum doğrulaması ve farklı açılardan kayıtlar aksini kanıtlıyor.

28 Şubat sabahı ABD ve İsrail’in İran’a karşı “önleyici savaş” başlatmasıyla Ortadoğu’da çatışmalar başladı. Savaşta İran’ın dini lideri Ayetullah Ali Hamaney başta olmak üzere pek çok üst düzey İranlı lider hayatını kaybetti.

Savaşın etkisi sosyal medyada da kendisini hissettiriyor. Her mecrada olaya ilişkin video ve görseller paylaşılıyor. Teyit, 4 Mart itibariyle 24 iddiayı analiz etti. İncelediğimiz görüntülerin büyük bir kısmı yapay zeka üretimiydi.

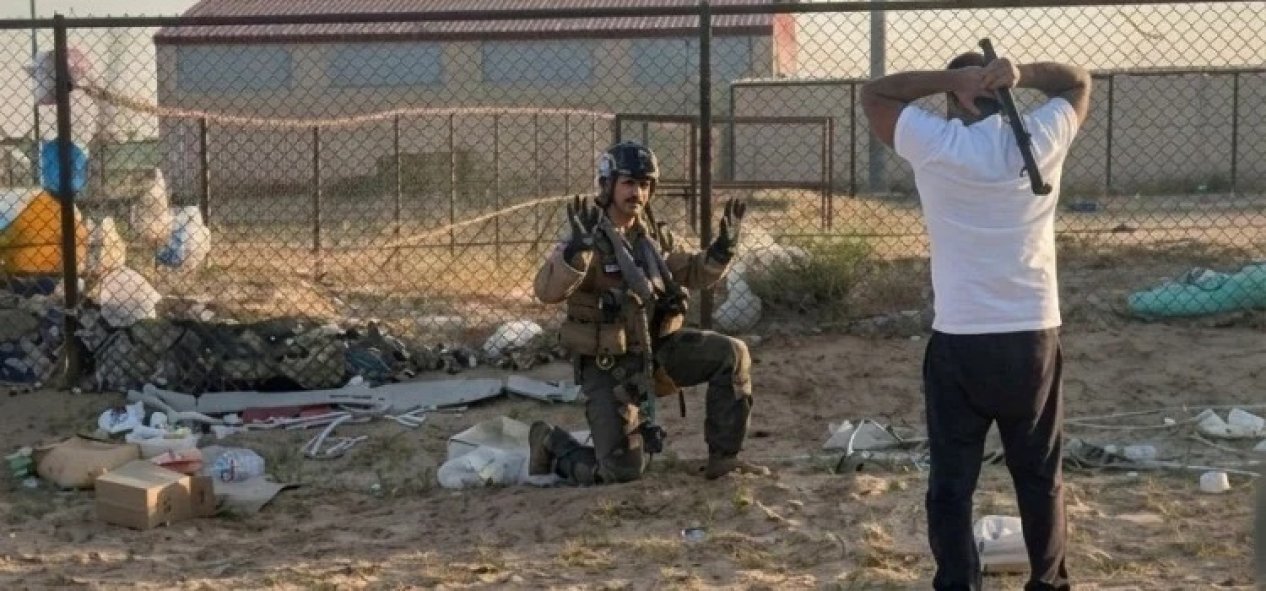

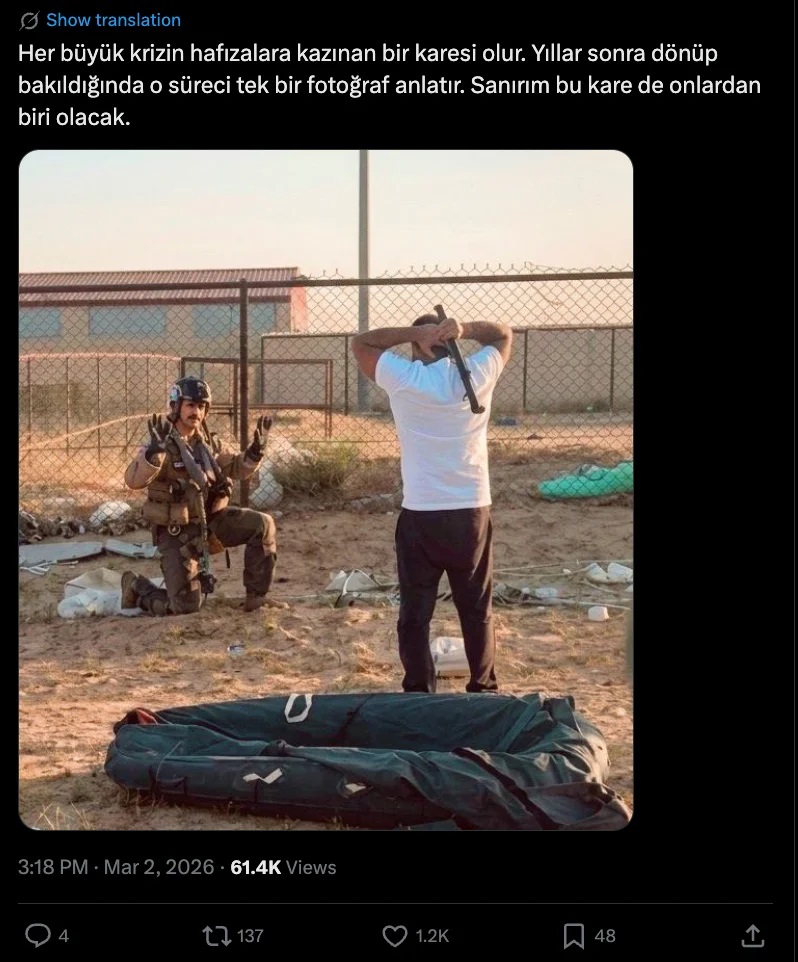

X’te karşıma çıkan bir iddiaya göre Bir Kuveytlinin elinde sopayla ABD askerine diz çöktürdüğünü gösteren görsel gerçekti. Görür görmez yapay zeka olduğunu düşündüğüm bu analiz etmek istedim ve görselin kaynağını araştırmaya başladım.

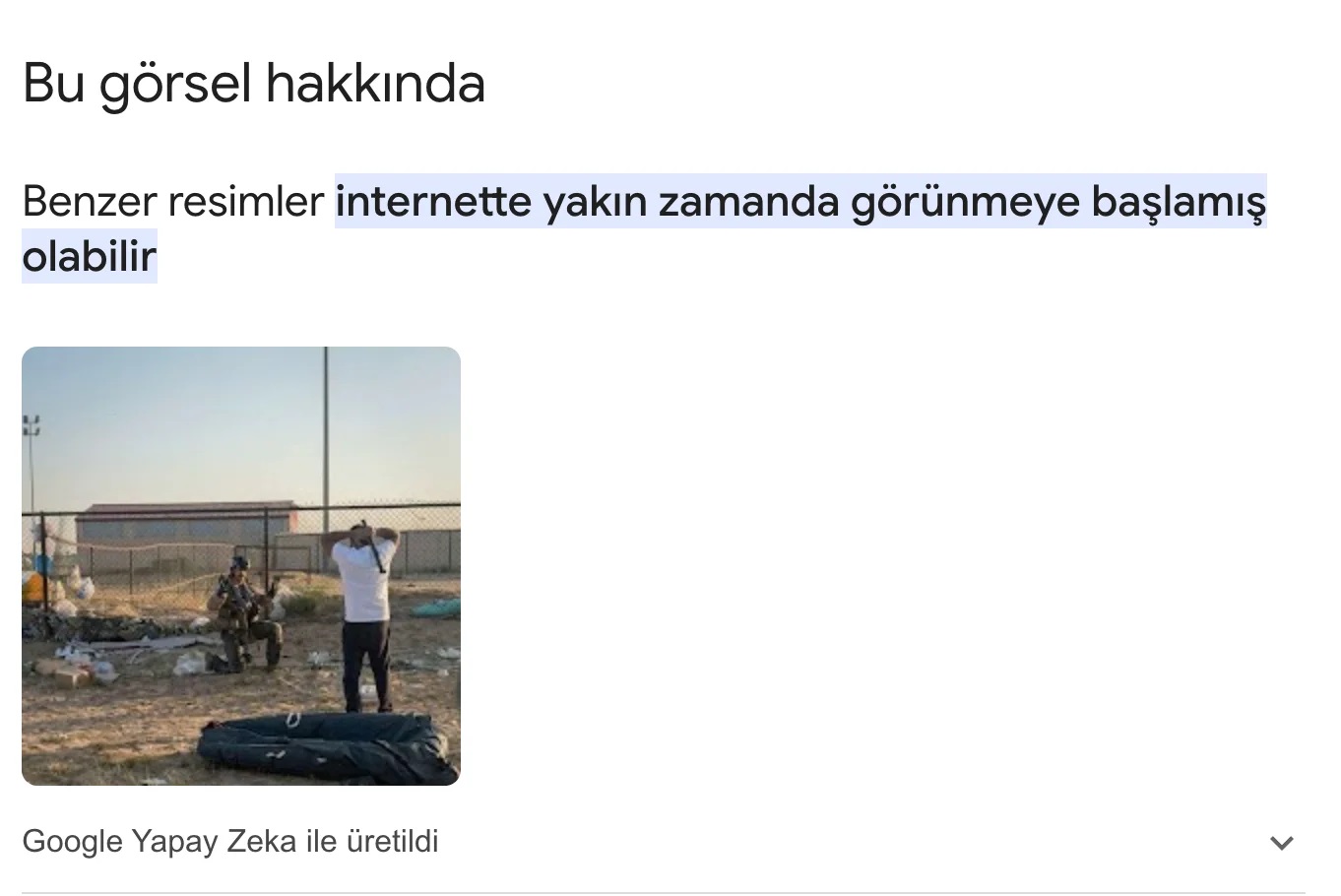

Tersine görsel arama sonucunda görselde SynthID filigranı tespit edildiğini gördüm. Gemini’a göre de bu görselde SynthID filigranı bulunuyor. Bu, Google’ın kendi yapay zeka modelleriyle üretilmiş içeriklere gömdüğü bir dijital filigran. Bu filigran, tersine görsel aramada ilk kaynağa ulaşmadan da görselin yapay zeka üretimi olduğunu tespit etmeye yarıyor.

Tersine görsel aramada ABD merkezli doğrulama platformu Snopes’un iddiayı “Yanlış” olarak etiketlediğini gördüm. Snopes’un analizindeki tek kaynak görseldeki SynthID filigranıydı.

Görsele bakınca ben de yapay zeka üretimi olduğuna ikna olmuştum. Görselin dokusu ve ellerdeki bozulmalar bunu destekler nitelikteydi.

Ancak, olay doğruydu. Gerçekten de ABD’li askerler düşen F-15 uçaklarından paraşütleriyle Kuveyt’e iniş yapmışlardı ve burada Kuveytli yerlilere denk gelmişlerdi. Olay yerinden araştırmacı gazetecilerin paylaştığı videolar ve konum doğrulama çalışmaları vardı.

Bu sebeple görselde SynthID filigranı bulunması şüphelerimizi gidermeye yetmedi ve araştırmayı derinleştirdik.

Olay yerinden videolar görseli doğruluyor

Sosyal medyada dolaşıma girmiş olan olay yerinden farklı açıdan kaydedilen bir videoda gerçekten de Kuveytli bir yerli olduğu tahmin edilen kişinin elinde sopayla ABD askerine karşı hamle yaptığı ve askerin bunun üzerine dizinin üstüne çöktüğü görülüyor.

Bu video Mart 2026’da yani olayın yaşandığı sıralarda dolaşıma girmiş. Dolayısıyla hatalı ilişkilendirilmiş gibi görünmüyor.

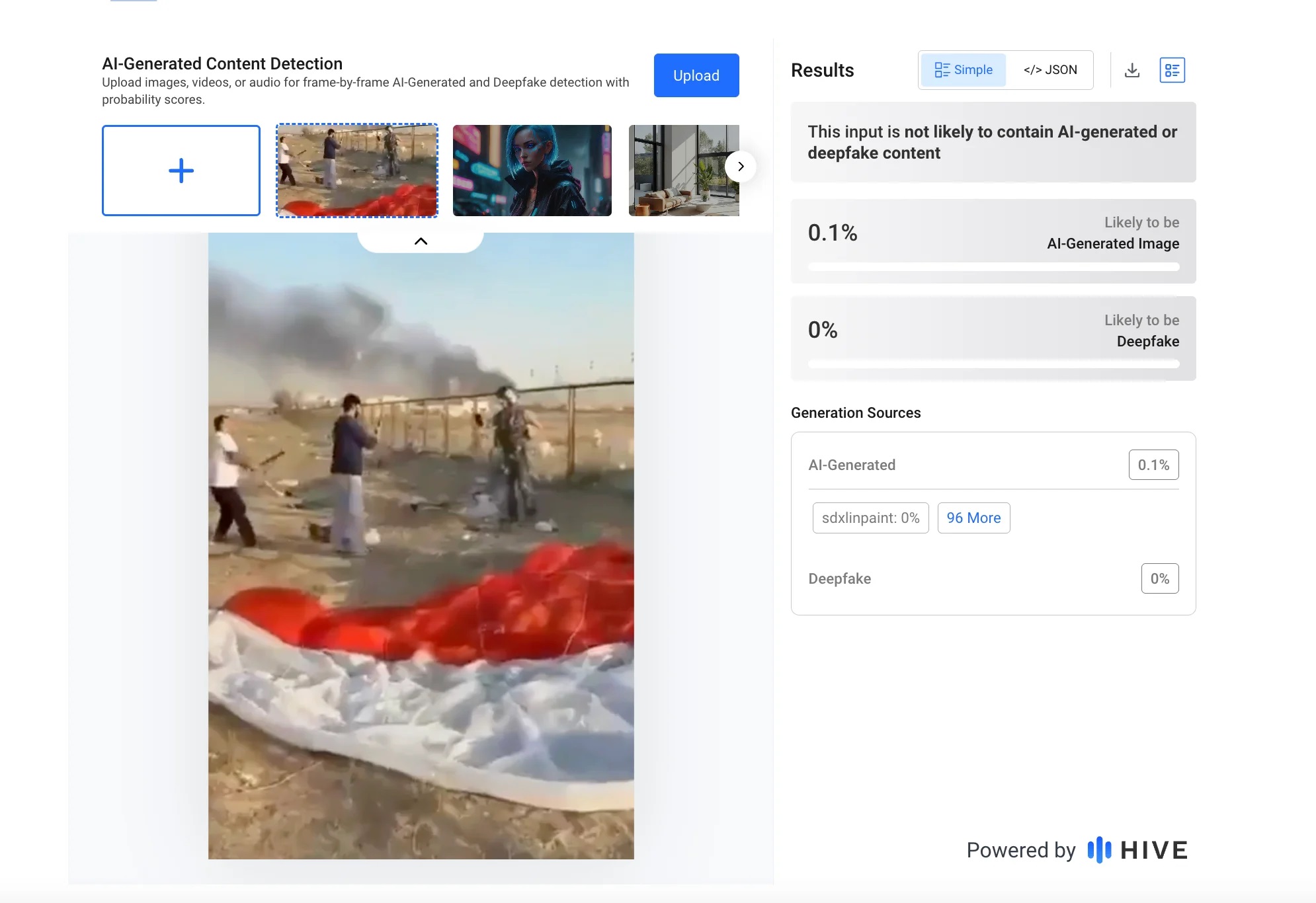

Video, birçok ulusal ve uluslararası haber kuruluşunca paylaşılmış ve aynı anlarda farklı açılardan video kayıtları bulunuyor. Ayrıca, fotoğrafın yapay zeka üretimi olduğunu gösteren bir kanıt yok.

Üstelik ABD askerinin Kuveyt’te düştüğü konum tespit edilebiliyor. Konum tespitine göre, video El Fervaniye kırsalında 29°10'50.70"N 47°48'37.17"E koordinatlarında kaydedilmiş.

Ek olarak, yapay zeka tespit aracı Hive Moderation’a göre video yapay zeka ürünü değil.

The Independent’ın aktarımına göre Kuveytli yerli, düşen F-15 pilotunu bir İran askeri sandığı için elindeki sopayı doğrulttu. Videoda arkadan “Geri çekil!”, “İndir onu!” gibi sesler geldiğiduyuluyor. Ayrıca askerin “Ben Amerikalıyım!” dediği ve ardından Kuveytli kişinin geri çekildiği görülüyor. Eli sopalı kişinin niyetini tespit etmek elbette mümkün değil. Ancak bu görüntü, olayın gerçekten yaşanmış olduğunu kanıtlıyor.

Anlaşılan o ki, fotoğraf videodakinden farklı bir açıdan çekilmiş. İranlı bir araştırmacı gazeteci, fotoğrafın epey düşük kaliteli bir halini 2 Mart Türkiye saatiyle 08.45’te paylaşmış. Ardından yüksek kaliteli bir hali hızlıca yayılmış.

Fikrimce, görselin kalitesini artırmak amacıyla Google’ın yapay zeka aracı Gemini kullanılmış olabilir. Bu da görselde SynthID filigranı oluşmasına sebep olmuş olabilir.

Analiz sonuçlarıyla ilgili Snopes’a ulaştık. Snopes standartlarına göre, bu şekilde iyileştirilmiş/düzenlenmiş bir görselin sahte sayıldığını ifade etti.

Bunun ardından ardından Snopes analiz sonucunu, “Bu doğrulama çalışmasında yer alan görselde SynthID ve yapay zeka kullanımının diğer bariz işaretleri bulunuyordu. Birinin mevcut bir görseli yapay zeka kullanarak geliştirerek bu görseli oluşturmuş olması mümkündü. Snopes, bu şekilde oluşturulan görselleri, gerçek görüntülere dayanıyor olsalar bile, sahte olarak değerlendiriyor.” notunu ekleyerek yeniden paylaşmış.

Şimdilik dijital filigranlar da çözüm değil

Yapay zeka araçlarının ulaşılabilirliğinin artmasıyla birlikte yaşanan her krizde en yaygın yanlış bilgi türlerinden biri yapay zekayla üretilmiş görüntüler oluyor.

Sosyal medya platformları yapay zeka üretimi içerik paylaşan kullanıcıların bunu belirtmesini teşvik ediyor. Farklı yapay zeka araçları, ürettikleri görsel içeriğe filigran ekliyor. Fakat kullanıcılar her zaman yapay zeka bilgisi paylaşmıyor, filigranlar kaldırılabiliyor.

Bu engelin üstesinden gelmek için Google, kendi yapay zeka araçlarıyla üretilen görsel içeriklere dijital bir filigran ekliyor. Bu filigran gözle görülemiyor ve silinemiyor. Pek çok iddiada SynthID filigranı tespiti kolaylaştırsa da bu iddia dijital filigranların da doğru ile yanlışı ayırt etmede yüzde yüz etkili bir yöntem olmadığını gösteriyor.